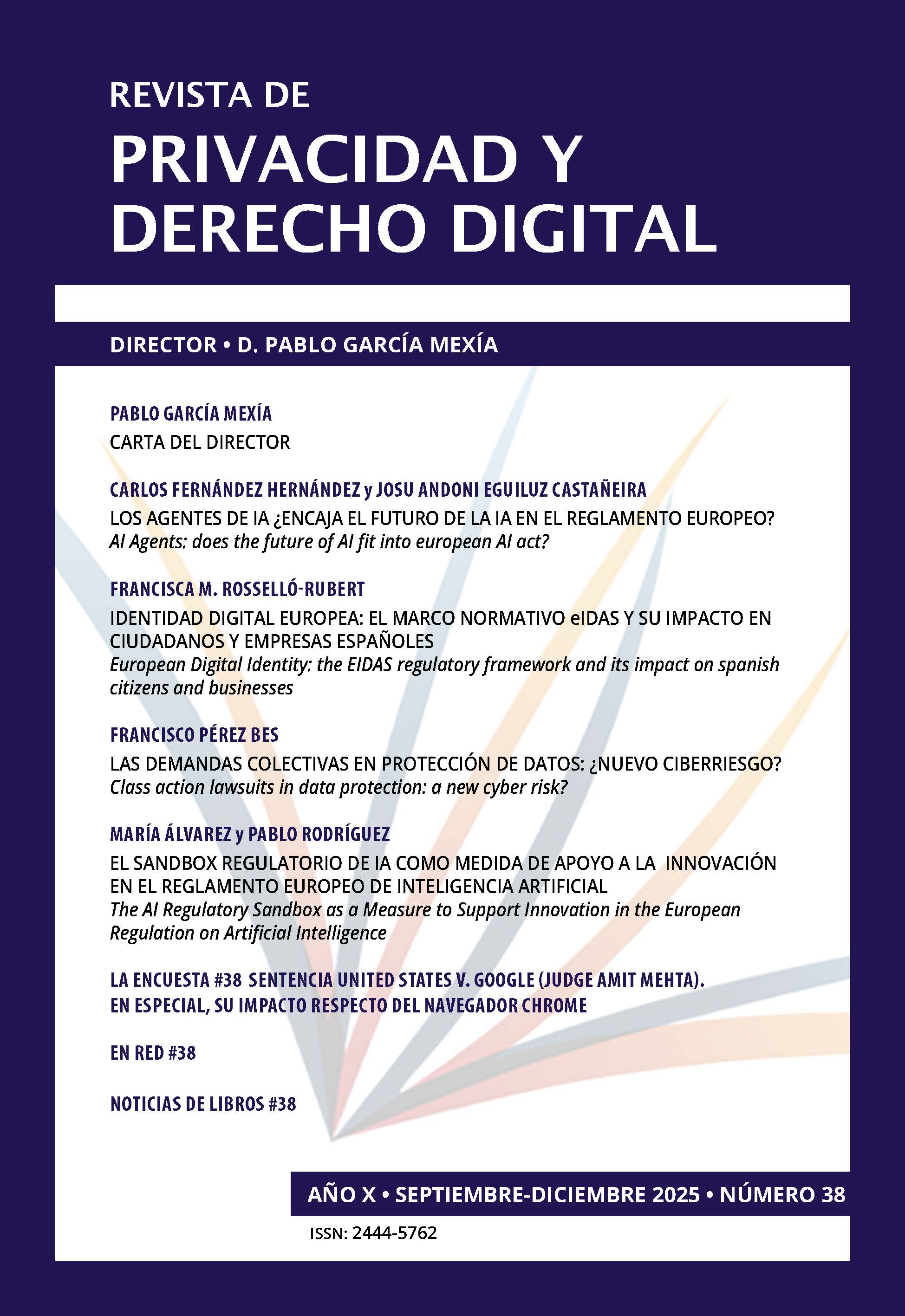

LOS AGENTES DE IA ¿ENCAJA EL FUTURO DE LA IA EN EL REGLAMENTO EUROPEO?

Palabras clave:

IA agéntica: Agentes de IA; Sistemas de IA; Sistemas de IA de propósito general; Riesgos; Autonomía; AgenciaResumen

Los agentes de IA basados en grandes modelos de lenguaje, constituyen, hoy por hoy, la base fundamental de los futuros desarrollos de la IA en una multiplicidad de campos. Pero la rapidísima evolución de estas tecnologías y de sus avanzadas capacidades en aspectos como la capacidad de inferencia, de toma autónoma de decisiones y de actuación o agencia, plantean interrogantes sobre el encaje de estos sistemas en el Reglamento europeo de IA, cuyo marco podría verse desbordado por la potencialidad de estos agentes, dando pie con ello a lagunas o vacíos regulatorios en un campo con profundas implicaciones sobre los derechos fundamentales de las personas o la responsabilidad. El objeto de este artículo es analizar el alcance general de estos agentes en su estado actual y las consecuencias de su previsible evolución en el marco normativo europeo

Descargas

Citas

ASKELL, A., BAI, Y., et. al. (2021). A general language assistant as a laboratory for alignment. arXiv.

BALAHUR-DOBRESCU, A. et al. (2022), Data quality requirements for inclusive, non-biased and trustworthy AI. Oficina de Publicaciones de la UE, Luxemburgo.

BOSTOEN, F., y KRÄMER, J. (2024). AI Agents and Ecosystems Contestability (Issue Paper). Centre on Regulation in Europe (CERRE).

BOSTROM, N. (2014). Superintelligence: Paths, dangers, strategies. Oxford University Press.

CHAN, A., SALGANIK, R., et al. (2023). Harms from increasingly agentic algorithmic systems. En Proceedings of the 2023 ACM Conference on Fairness, Accountability, and Transparency.

CHONG, Ng S.T. (2025). The Rise of the Deceptive Machines: When AI Learns to Lie, United Nations University, Campus Computing Centre (C3).

CHRISTIAN, B. (2020). The alignment problem: Machine learning and human values. W. W. Norton & Company.

COBBE, J., VEALE, M., SINGH, J. (2023). “Understanding accountability in algorithmic supply chains”. En Proceedings of the 2023 ACM Conference on Fairness, Accountability, and Transparency (FAccT ’23), Chicago, IL

COHEN, M. K. et al. (2024). “Regulating advanced artificial agents”. Science, vol. 384, nº 6691.

COMISIÓN EUROPEA. (2020). Libro Blanco sobre la inteligencia artificial: un enfoque europeo orientado a la excelencia y la confianza (COM (2020) 65 final).

COMISIÓN EUROPEA. (2025). Directrices sobre la definición de un sistema de inteligencia artificial establecida por el Reglamento (UE) 2024/1689 (RIA).

COMISIÓN EUROPEA. (2025). Directrices de la Comisión sobre las prácticas de IA inteligencia artificial prohibidas que se establecen en el Reglamento (UE) 2024/1689 (RIA).

D'AMOUR, A., HELLER, K., et. al. (2022). Underspecification presents challenges for credibility in modern machine learning. En Journal of Machine Learning Research, 23(226).

EBERS, M. (2024). Truly Risk-based Regulation of Artificial Intelligence: How to Implement the EU’s AI Act. European Journal of Risk Regulation.

ERIKSSON, M., PURIFICATO, E., et al. (2025). Can we trust ai benchmarks? an interdisciplinary review of current issues in ai evaluation. arXiv.

EUROPEAN LAW INSTITUTE (2025). Guiding Principles and Model Rules on Digital Assistants for Consumer Contracts.

FENG, K. J., MCDONALD, D. W., et al. (2025). Levels of Autonomy for AI Agents. arXiv.

FERNÁNDEZ HERNÁNDEZ, C., y EGUILUZ CASTAÑEIRA, J. A. (2024). Posibles vías de evitar la aplicación del Reglamento de IA: ¿Veremos una nueva “huida” del Derecho? Revista de Privacidad y Derecho Digital, 9(35), 275–291.

GARCÍA MEXÍA, P. (2025). Agentes de inteligencia artificial: una inoportuna laguna para la regulación europea. Cinco Días.

GOBIERNO DEL REINO UNIDO. (2023). Declaración de Bletchley de los países participantes en la Cumbre sobre Seguridad de la IA.

GOBIERNO DE REINO UNIDO. (2025). International AI Safety Report. The International Scientific Report on the Safety of Advanced AI. AI Action Summit.

GRUPO DE EXPERTOS DE ALTO NIVEL SOBRE INTELIGENCIA ARTIFICIAL. (2019). Directrices éticas para una IA fiable. Comisión Europea.

HAMMOND, L., CHAN, A., et. al. (2025). Multi-agent risks from advanced ai.

HU, H., LERER, A., et al. (2020). “Other-play” for zero-shot coordination. En International Conference on Machine Learning, págs. 4399-4410. PMLR.

JUNKLEWITZ, H., HAMON, R., et. al. (2023). Cybersecurity of artificial intelligence in the AI Act (JRC134461). Oficina de Publicaciones de la Unión Europea.

KRAPRAYOON, J., WILLIAMS, Z., et al. (2025). AI Agent Governance: A Field Guide. arXiv.

KOLT, N. (2025). Governing AI agents. arXiv.

KWON, J. (2025). AI agents: Governing autonomy in the digital age. Center for AI Policy.

LEHMAN, J., CLUNE, J., et. al. (2020). The surprising creativity of digital evolution: A collection of anecdotes from the evolutionary computation and artificial life research communities. Artificial life, 26(2).

MAK, A. (2025). 5 questions for Daniela Rus. Politico.

MASLEJ, N., FATTORINI, L., et al. (2025). “Apartado 4.3: Investment”, en The AI Index 2025 Annual Report, Institute for Human-Centered AI, Stanford University, Stanford (CA).

MCLAUCHLAN, M. (2025). Yoshua Bengio warns of “catastrophic risks” of agentic AI at World Summit AI. Betakit.

MITCHELL, M., et al. (2025). Fully autonomous AI agents should not be developed. Hugging Face Research.

NOLTE, H., RATEIKE, M., y FINCK, M. (2025). Robustness and cybersecurity in the EU Artificial Intelligence Act. In Proceedings of the 2025 ACM Conference on Fairness, Accountability, and Transparency.

OPENAI. (2023). GPT-4 System Card.

OPENAI. (2023). Practices for governing agentic AI systems.

OUESLATI, A., y STAES-POLET, R. (2025). Ahead of the Curve: Governing AI Agents under the EU AI Act. The Future Society.

OWASP. (2025). Agentic AI: Threats and mitigations. OWASP Foundation.

PARK, P.S., GOLDSTEIN, S., et al. (2023). AI deception: A survey of examples, risks, and potential solutions. Patterns.

REUTERS. (2025). Over 40 % of agentic AI projects will be scrapped by 2027, Gartner says.

RIEDL, M. O., y DESAI, D. R. (2025). AI Agents and the Law. arXiv.

RUSSELL, S. (2019). Human compatible, AI and the problem of control. Viking

RUSSELL, S. Y NORVIG, P. (2022). Artificial Intelligence. A modern approach. Edición 4, Pearson

SAPKOTA, R., et al. (2025). AI Agents vs. Agentic AI: A Conceptual Taxonomy, Applications and Challenges. arXiv preprint.

SCHOEN, B. et al. (2025). Stress Testing Deliberative Alignment for Anti-Scheming Training. arXiv preprint.

SÖDER, L., et al. (2024). Levels of Autonomy: Liability in the age of AI Agents. En Proceedings of the Workshop on Socially Responsible Language Modelling Research, OpenReview.

SÖDER, L., et. al. (2025). An autonomy-based classification: AI agents, liability and lessons from the Automated Vehicles Act. Interface. (http://interface-eu.org/publications/ai-agent-classification).

SULEYMAN, M. (2023). The Coming Wave: Technology, Power, and the Twenty-First Century’s Greatest Dilemma. Penguin Press.

ZITTRAIN, J. (2024). We Need to Control AI Agents Now. The Atlantic.